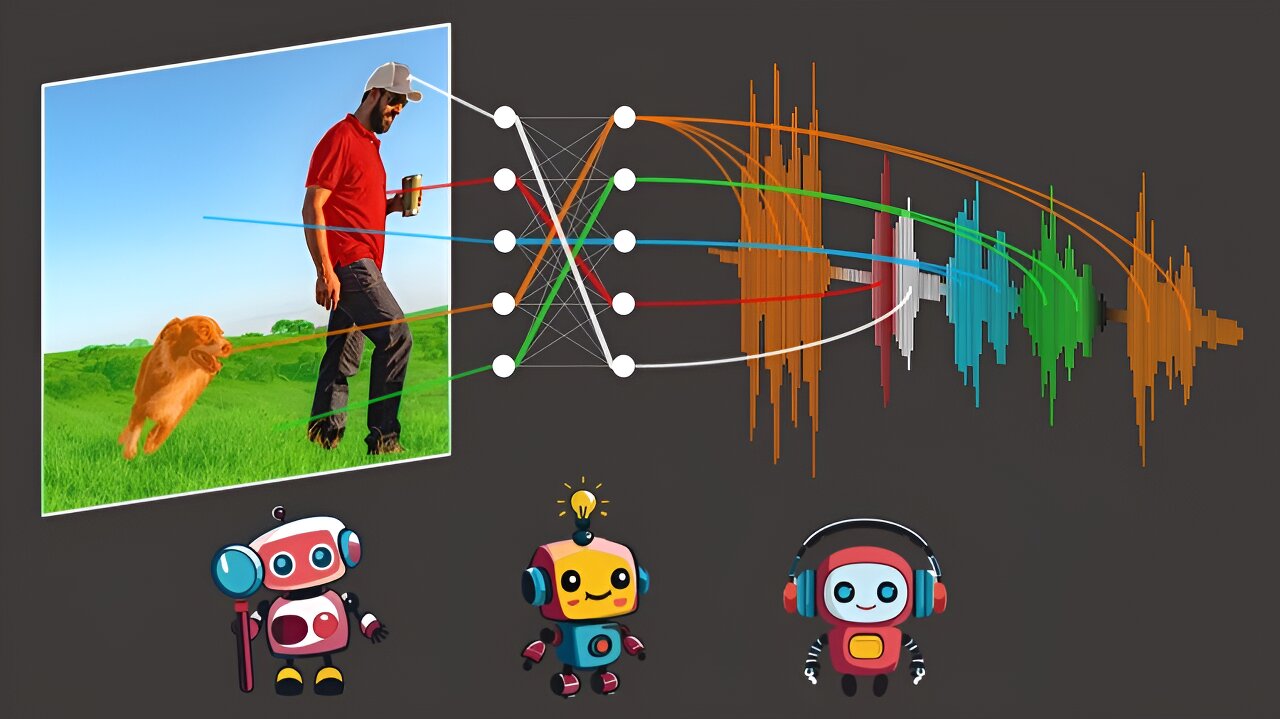

新算法仅通过观看视频就能发现语言

DenseAV 算法仅通过关联音频和视频信号来学习语言的含义。图片来源:Mark Hamilton 麻省理工学院电气工程和计算机科学博士生、麻省理工学院计算机科学和人工智能实验室 (CSAIL) 成员马克·汉密尔顿 (Mark Hamilton) 希望利用机器来了解动物的交流方式。为此,他首先着手创建一个可以“从零开始”学习人类语言的系统。 “有趣的是,灵感的关键时刻来自电影《帝企鹅日记》。电影中有一个场景,一只企鹅在穿越冰面时摔倒了,站起来时发出一声痛苦的呻吟。当你观看它时,几乎可以肯定,这声呻吟代表了一个四个字母的单词。正是在那一刻,我们想到,也许我们需要使用音频和视频来学习语言。”汉密尔顿说。“有没有办法让算法整天看电视,然后从中弄清楚我们在说什么?” “我们的模型 DenseAV 旨在通过根据听到的内容预测看到的内容来学习语言,反之亦然。例如,如果你听到有人说‘在 350 度下烤蛋糕’,那么你很可能看到的是蛋糕或烤箱。要想在数百万个视频的音频视频匹配游戏中取得成功,模型必须了解人们在谈论什么,”汉密尔顿说。 A 描述工作的论文 出现在 论文集 预印本服务器。 在他们训练 DenseAV 玩这个匹配游戏后,汉密尔顿和他的同事们开始观察模型在听到声音时寻找哪些像素。例如,当有人说“狗”时,算法会立即开始在视频流中寻找狗。通过查看算法选择了哪些像素,人们可以发现算法认为单词是什么意思。 有趣的是,当 DenseAV 听到狗叫时也会发生类似的搜索过程:它在视频流中搜索狗。 “这激起了我们的兴趣。我们想看看算法是否知道‘狗’这个词和狗叫声之间的区别,”汉密尔顿说。该团队通过给 DenseAV 一个“双面大脑”来探索这一点。有趣的是,他们发现 DenseAV 的大脑一侧自然专注于语言,比如“狗”这个词,另一侧专注于吠叫之类的声音。这表明 DenseAV 不仅学会了单词的含义和声音的位置,还学会了区分这些类型的跨模态连接,所有这些都不需要人工干预或任何书面语言知识。 其中一个应用分支就是从每天发布到互联网的大量视频中进行学习。 汉密尔顿说:“我们希望系统能够从大量视频内容(例如教学视频)中学习。另一个令人兴奋的应用是理解新的语言,例如海豚或鲸鱼的交流,这些语言没有书面交流形式。我们希望 DenseAV 可以帮助我们理解这些从一开始就逃避人类翻译努力的语言。最后,我们希望这种方法可以用来发现其他信号对之间的模式,例如地球发出的地震声和它的地质。” 图片来源:麻省理工学院 团队面临着一项艰巨的挑战:在没有任何文本输入的情况下学习语言。他们的目标是从一张白纸上重新发现语言的含义,避免使用预先训练的语言模型。这种方法的灵感来自于儿童通过观察和聆听周围环境来理解语言的方式。 为了实现这一壮举,DenseAV 使用两个主要组件分别处理音频和视觉数据。这种分离使算法无法作弊,因为视觉部分负责处理音频,反之亦然。它迫使算法识别物体,并为音频和视觉信号创建详细而有意义的特征。DenseAV 通过比较音频和视觉信号对来学习,以找出哪些信号匹配,哪些信号不匹配。这种方法称为对比学习,不需要标记示例,并允许 DenseAV 找出语言本身的重要预测模式。 DenseAV 与之前的算法之间的一个主要区别是,之前的研究只关注声音和图像之间的相似性这一单一概念。整个音频片段(例如某人说“狗坐在草地上”)与整张狗的图像相匹配。这使得之前的方法无法发现细粒度的细节,例如单词“草”与狗下面的草之间的联系。 该团队的算法会搜索并汇总音频片段和图像像素之间所有可能的匹配。这不仅提高了性能,还使该团队能够以以前的算法无法做到的方式精确定位声音。 “传统方法使用单一类别标记,但我们的方法会比较声音的每个像素和每一秒。这种细粒度的方法让 DenseAV 能够建立更详细的连接,从而实现更好的定位,”汉密尔顿说。 研究人员在 AudioSet 上训练了 DenseAV,其中包含 200 […]