“值得称赞”和“一丝不苟”等词的过多暗示了 ChatGPT 在数千项科学研究中的使用 | 技术

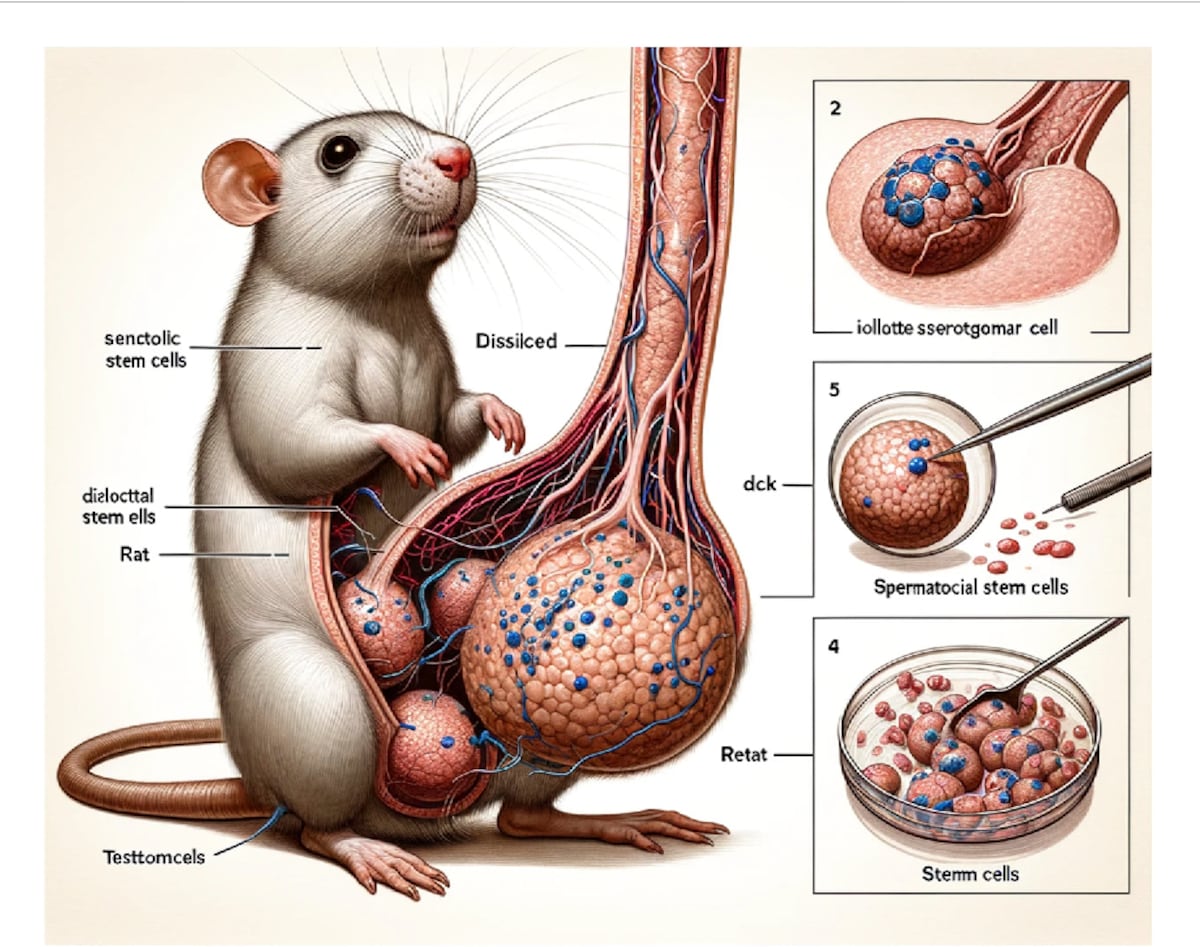

图书管理员 安德鲁·格雷 有了一个“非常令人惊讶”的发现。 他分析了去年发表的 500 万份科学研究,并发现 突然高 在他们的英文版本中,某些词语的使用存在差异,例如细致地(上升137%)、复杂(117%)、值得赞扬(83%)和细致(59%)。 伦敦大学学院的格雷只能找到一种解释:数以万计的研究人员正在使用 ChatGPT – 或其他类似的人工智能语言生成程序 – 来撰写他们的研究或至少“润色”它们。 有明显的例子。 中国科学家团队2月17日发表 一项研究 关于锂电池。 这项工作发表在爱思唯尔出版社的一本专业杂志上,开头是这样的:“当然,这里有一个可能的主题介绍:锂电池是……的有前途的候选者”。 作者显然要求 ChatGPT 提供介绍并按原样复制。 其他 文章 以色列研究人员于 3 月 8 日签署的另一本爱思唯尔期刊中包含这样的文字:“总而言之,双侧医源性损伤的管理我很抱歉,但我无法获得实时信息或患者特定数据,因为我是一个人工智能语言模型。” 几个月前,三名中国科学家发表了一幅疯狂的图画,画的是一只长着巨大阴茎的老鼠,这是一张由人工智能生成的图像 一项研究 关于精子前体细胞。 更多信息 Andrew Gray 估计,至少 60,000 项科学研究(超过 2023 年分析的科学研究的 1%)是在 ChatGPT(2022 年底推出的工具)或类似工具的帮助下撰写的。 “我认为用 ChatGPT 撰写完整研究的极端案例很少见,”41 岁的苏格兰图书馆员 Gray 说。 在他看来,大多数情况下,人工智能被适当地用来“润色”文本——识别错别字或方便翻译成英文——但存在很大的灰度,其中一些科学家进一步利用ChatGPT的帮助,而没有验证结果。 “现在不可能知道这个灰色地带有多大,因为科学期刊不要求作者声明使用 ChatGPT,透明度非常低,”他感叹道。 正如该团队所表明的那样,人工智能语言模型不成比例地使用某些单词。 詹姆斯·邹,来自斯坦福大学(美国)。 这些术语往往具有积极的含义,例如值得称赞、细致、复杂、创新和多才多艺。 […]

CSIC 和 50 个组织拒绝限制世界科学的私人数据库 | 科学

12月8日,法国索邦大学引发了世界科学界的地震。 广告 谁取消了他的订阅 科学网是伦敦跨国公司科睿唯安 (Clarivate) 的一个无处不在的数据库,在世界各地用于评估科学家并给予或不给予他们晋升和资助。 数亿欧元的公共资金根据来自私人平台(尤其是 Web of Science 和 Web of Science)的数据进行分配。 斯科普斯,荷兰出版商 Elsevier 的类似工具。 索邦大学和另外 50 个组织,包括西班牙科学研究高级委员会 (CSIC),于本周二提出 巴塞罗那宣言一项从根本上改造该系统并使其开放的举措。 签署者警告说,科学家的职业生涯,甚至“科学为全人类服务的方式”目前都依赖于这些不透明且往往不可靠的指标。 一年前,《国家报》披露,19名西班牙研究人员在科睿唯安数据库中撒谎,以换取金钱,假装自己在沙特阿拉伯工作,以人为地提升沙特大学在沙特阿拉伯的地位。 排名 国际学者。 伦敦公司每年生产 高被引科学家名单根据这些不透明的指标,其中包括 7,000 名研究人员,他们的研究被其他同事提及最多。 近年来,该名单已成为肆无忌惮的平庸科学家的滋生地,他们通过各种手段获得了该名单。 11 月份,科睿唯安因这些不良行为而排除了 1000 多家公司。 更多信息 “所有研究信息的很大一部分都被锁在私人基础设施中。 它由主要对其股东负责的公司运营,而不是对研究界负责。 作为一个研究团体,我们已经变得非常依赖封闭的基础设施,”《巴塞罗那宣言》的签署者反映道。 比安卡·克莱默来自荷兰咨询公司 Sesame Open Science; 卡梅伦·奈伦,来自科廷大学(澳大利亚); 和 游戏沃尔特曼来自莱顿大学(荷兰)。 该倡议的发起人于 2023 年 11 月在巴塞罗那举行会议,会议由 SIRIS 学术是一家巴塞罗那咨询公司,为世界各地的学术实体提供咨询服务。 这位瑞士专家表示:“深刻的信息是,Web of […]