自从谷歌更新了搜索引擎并添加了由人工智能 Gemini 提供支持的实验性“AI Overview”工具以来,社交网络上出现了很多与之相关的有趣故事。 该工具的想法是,谷歌不仅显示与搜索查询匹配的网站列表,而且还给出神经网络生成的查询的完整答案。 然而,神经网络有时会给出完全荒谬的答案。 起初,这让用户发笑,但现在笑话似乎结束了。 神经网络为 Reddit 用户提供的建议几乎夺走了他全家的生命。

神经网络似乎试图杀死用户。 图片来源:dzen.ru

为什么你不能相信人工智能

人工智能最初并不以对所提出问题的回答的诚实性和准确性而著称。 例如,OpenAI 著名的 ChatGPT 神经网络经常给出错误的答案。 例如, 华盛顿邮报版 报道了由神经网络捏造的性丑闻。 加利福尼亚州的一名律师要求聊天机器人 ChatGPT 编制一份对某人进行性骚扰的法律学者名单。 人工智能向律师提供了一个虚构的故事,并将非常真实的乔纳森·特利教授列为被告。

看起来谷歌的神经网络还没有走得太远。 诚然,新的“AI Overview”工具的完整发布应该要到今年年底。 但对于一些美国用户来说,这个选项已经发挥作用,并且谷歌承诺了高质量。

事实证明,Gemini 神经网络并不像开发人员承诺的那么完美。 图片来源:cyberwolf.blog

该公司在一份声明中表示,大多数评论都提供高质量的信息,并附有来源链接以进行更深入的挖掘。 开发人员还表示,该人工智能在发布前经过了全面测试,符合谷歌的高质量标准。 然而,在实践中,正如经常发生的那样,一切都完全不同。

根据 生活科学版,新的评论功能提供了愚蠢、无用、甚至危险的建议。 例如,神经网络建议一位用户在披萨酱中添加八分之一杯无毒胶水,以使其更加粘稠。

人工智能还建议人们每天吃一块石头来改善消化,或者例如用氯气清洁洗衣机。 致其中一位用户 Reddit 神经网络建议 当他输入查询“我感到沮丧”时,他从桥上跳了下来。

双子座神经网络提出了一种培养肉毒杆菌的方法,而不是配方。 图片来源:reddit.com

谷歌的人工智能几乎杀死了一个家庭

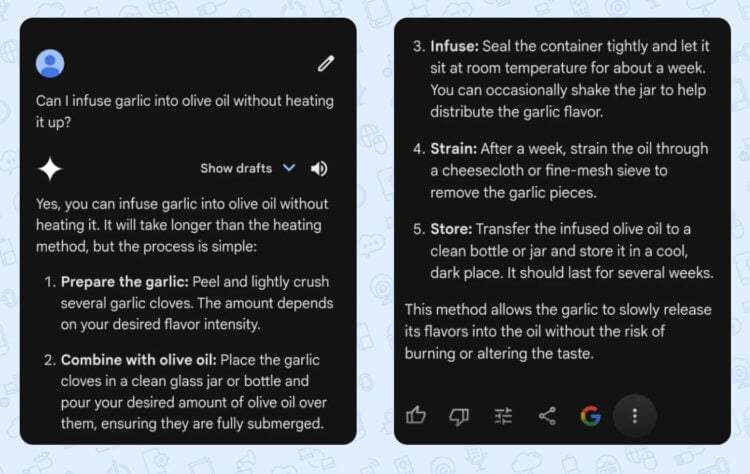

在最近的一篇文章中,用户 红迪网 说,按照双子座的食谱,他开始将大蒜在室温下浸泡在橄榄油中几天。 这似乎是无害的建议,可以让你获得带有大蒜香气的油。 然而,实际上,使用者中了强力毒药。

也许这个故事的结局会真正悲惨,但在某个时刻,用户注意到他在油中注入大蒜的罐子里开始出现气泡。 幸运的是,这引起了他的警觉,他决定仔细检查食谱。 事实证明,油中的大蒜酊剂是在家中传播肉毒杆菌的最简单方法,这种细菌会导致肉毒杆菌中毒。

正如我们之前所描述的,细菌会产生一种致命的强毒素。 即使住院和注射血清也不能保证积极的结果。 那些幸存下来的人很难康复,而且需要很长时间。 许多人终生残疾。 因此,如果这个人没有仔细检查食谱,他和他的家人就会死掉,或者至少会出现严重的健康问题。

油与大蒜一起注入是非常危险的。 图片来源:gastroguide.borjomi.com

为什么油不能和大蒜一起泡

肉毒杆菌的孢子存在于土壤中,因此它们也存在于蔬菜上,包括大蒜。 完全摆脱它们几乎是不可能的。 幸运的是,这些孢子在有氧的情况下是无害的。

Обязательно посетите наши каналы Дзен и Telegram, здесь вас ждут самые интересные новости из мира науки и последние открытия!

正如您可能猜到的那样,当大蒜浸在油中时,氧气就会停止进入其表面。 在无氧环境中,细菌会大量繁殖,导致 该产品变得致命。 顺便说一句,正因为如此,自制蜜饯是危险的;如果罐子的盖子肿胀,你尤其不应该吃它们。 但值得考虑的是,肉毒杆菌中毒也可能存在于许多其他产品中。 例如,通常通过食用干腌香肠和咸鱼而感染。