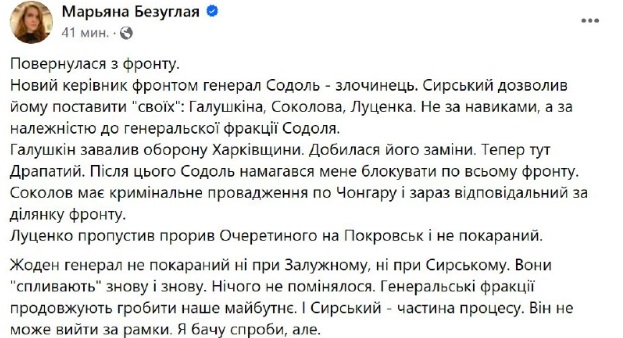

OpenAI 正在应对艺术家、作家和出版商的诉讼,他们指控 OpenAI 不当使用他们的作品来训练 ChatGPT 和其他人工智能系统背后的算法。 周二,该公司宣布推出一款工具,显然是为了安抚创意人员和权利持有者,让他们对 OpenAI 如何使用其作品有一定的控制权。

该公司表示将于 2025 年推出一款名为 Media Manager 的工具,允许内容创作者选择将他们的作品从公司的人工智能开发中剔除。 在 一篇博文OpenAI 将该工具描述为一种允许“创作者和内容所有者告诉我们他们拥有什么”并指定“他们希望如何将自己的作品纳入或排除在机器学习研究和培训之外”的方式。

OpenAI 表示,它正在与“创作者、内容所有者和监管机构”合作开发该工具,并打算“设定行业标准”。 该公司没有透露该项目的任何合作伙伴的名称,也没有明确说明该工具将如何运行。

关于该系统的悬而未决的问题包括内容所有者是否能够提出一个请求来涵盖他们的所有作品,以及 OpenAI 是否允许与已经训练和启动的模型相关的请求。 关于机器“忘却”的研究正在进行中,这是一种调整人工智能系统以追溯性地消除其训练数据的一部分的贡献的过程,但该技术尚未完善。

初创公司 Fairly Trained 负责对使用道德来源训练数据的人工智能公司进行认证,其首席执行官 Ed Newton-Rex 表示,OpenAI 对训练数据的明显转变值得欢迎,但实施也至关重要。 “我很高兴看到 OpenAI 参与解决这个问题。 它是否真的能帮助艺术家将取决于细节,目前尚未提供,”他说。 他想到的第一个主要问题是:这是否只是一个选择退出工具,让 OpenAI 在未经许可的情况下继续使用数据,除非内容所有者请求排除? 或者它会代表 OpenAI 业务方式的更大转变吗? OpenAI 没有立即回复置评请求。

Newton-Rex 也很想知道 OpenAI 是否会允许其他公司使用其媒体管理器,以便艺术家可以同时向多个 AI 开发人员表明他们的偏好。 “如果不这样做,它只会给已经很复杂的选择退出环境增加进一步的复杂性,”Newton-Rex 说,他曾是 Stability AI 的高管,也是 Stable Diffusion 图像生成器的开发人员。

OpenAI 并不是第一个为艺术家和其他内容创作者寻找方法来表达他们对将其作品和个人数据用于人工智能项目的偏好的公司。 从 Adobe 到 Tumblr,其他科技公司也提供有关数据收集和机器学习的选择退出工具。 初创公司 Spawning 推出了一个名为 不要训练 近两年前,创作者们已经添加了15亿部作品的喜好。

Spawning 首席执行官 Jordan Meyer 表示,该公司并未与 OpenAI 合作开发媒体管理器项目,但对此持开放态度。 “如果 OpenAI 能够使注册或尊重普遍选择退出变得更容易,我们将很乐意将他们的工作纳入我们的套件中,”他说。